Deepseek本地知识库搭建方案最详细说明

Deepseek本地知识库搭建方案最详细说明

本地个人知识库搭建方案

方案一

Ollama操作软件(本地安装大模型的运行平台)

Deepseek-r1大模型

Nomic-embed-text:lates文本向量化模型

AnythingLLM知识库管理软件

方案二

Ollama操作软件(本地安装大模型的运行平台)

Deepseek-r1大模型

Nomic-embed-text:lates文本向量化模型

Cheery studio知识管理软件(支持多模型服务的GPT/Claude客户端,支持Windows/macOS/Linux操作系统)

Ollama软件

简介

Ollama是一款开源的本地化大型语言模型(LLM)运行平台工具,以下是具体介绍:

功能特性

本地化部署:可在个人电脑或服务器上直接运行开源大模型,如Llama3、Mistral、Phi-3等,无需依赖云端API,保障数据隐私。

轻量级容器管理:通过类似Docker的命令行工具管理模型容器,能快速下载、切换和运行模型。

一键部署模型:使用单条命令即可完成模型下载、加载和交互,操作便捷。

多模型并行支持:可同时运行多个模型实例,且互不干扰,满足不同任务需求。

跨平台兼容:支持Windows、macOS、Linux(包括ARM架构如树莓派)等多种操作系统。

RAG集成:可结合本地文档库实现检索增强生成,提升模型输出的准确性和相关性。

API服务暴露:通过REST API或OpenAI兼容接口,方便其他应用调用本地模型。

多模态扩展:支持Whisper(语音)、BakLLaVA(图像)等多模态插件,拓展应用场景。

应用场景

本地开发测试:开发者无需购买云端算力即可在本地调试模型,降低开发成本。

私有化部署:企业可在其内网运行定制模型,满足医疗、金融等对数据隐私要求高的场景需求。

教育/研究:学术机构能够以低成本探索LLM能力边界,推动相关研究发展。

边缘计算可在IoT设备(如NVIDIA Jetson)上部署轻量级模型,实现边缘智能应用。

安装

Deepseek- r1大模型本地布署

首先进入网站:https://ollama.com/download,如图 2.2‑1,依据下载电脑的操作系统(Windows、macOS、Linux)选取对应选项→点击“Download for windows” →文件进行下载模式→下载OllamaSetup.exe可执行文件。。

图 2.2‑1 Ollama软件安装网站

双击OllamaSetup.exe可执行文件→进行安装状态→待安装好后再进入图 2.2‑1网页。

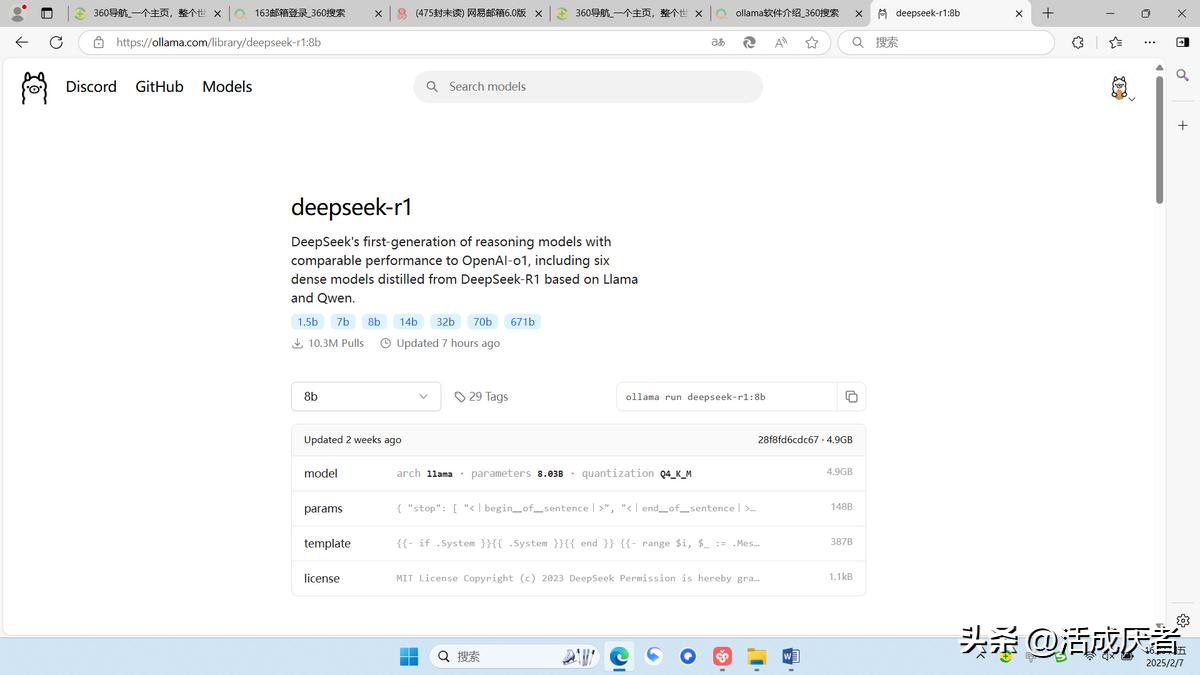

点选页面左上方“modles” →选取“Deepseek- r1”模型(见图 2.2‑2,本地普通PC建议安装版本选1.5b、7b、8b版,最大14b,大于14b普通PC运行不)。

图 2.2‑2 大模型软件选择

先取图 2.2‑3绿色框选取“8b”版本→复制红色框中代码。

图 2.2‑3 大模型软件配置选择

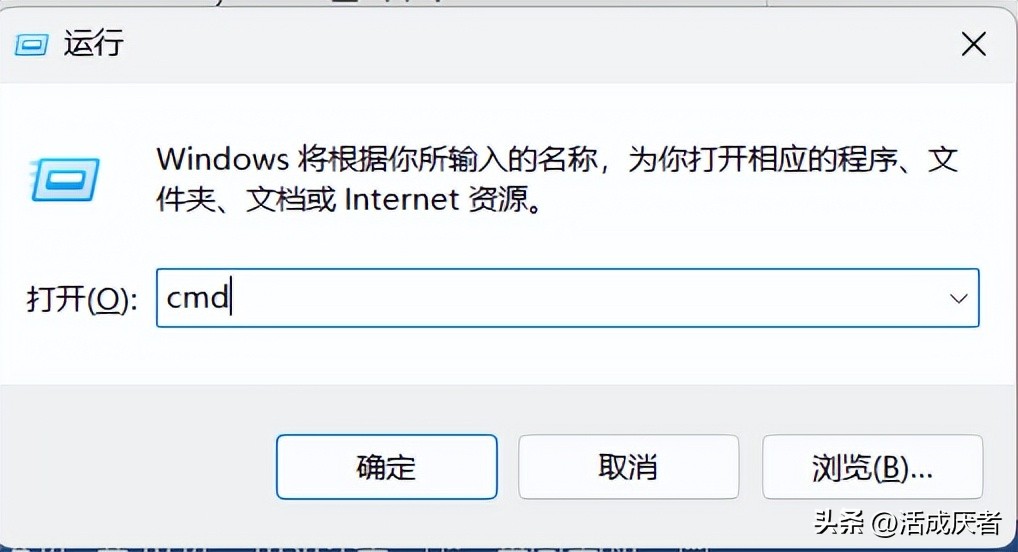

Windows操作系统按“视窗键win+R” →弹出运行窗口(图 2.2‑4)输入命令“cmd” →点击”确定“→弹出”命令行窗口“(图 2.2‑5)→在”命令行窗口“点鼠标右键粘入上文第4)步复制的红框中代码→回车→开始安装Deepseek-r1 8b版文件(安装时间较长请烦心等待)。

图 2.2‑4 windows运行窗口

图 2.2‑5 windows运行窗口

第5)步安装好后即可在运行窗口提示符下输入问题,大模型启动思考,本地机安装布署完成。

ollama基础命令

ollama list 列出已下载本地的模型文件名称。

下载模型可使用“ollama pull [模型名称]”,如“ollama pull llama3:8b-instruct-q4_K_M”;

运行模型交互使用“ollama run [模型名称]”;

Nomic-embed-text:lates文本向量化大模型本地布署

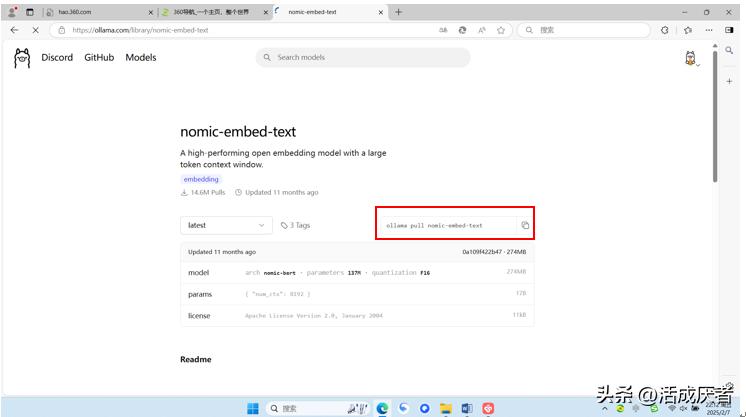

点选页面左上方“modles” →选取“nomic-embed-text:latest”模型(见图 2.2‑6)→复制红色框中代码。

图 2.2‑6 向量化大模型软件选择

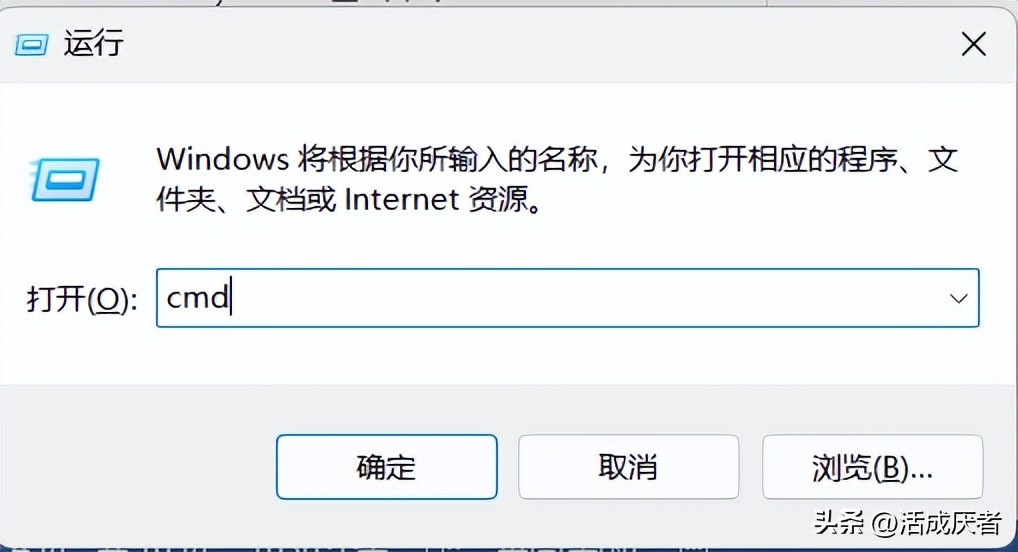

Windows操作系统按“视窗键win+R” →弹出运行窗口(图 2.2‑7)输入命令“cmd” →点击”确定“→弹出”命令行窗口“(图 2.2‑8)→在”命令行窗口“点鼠标右键粘入上文第1)步复制的红框中代码→回车→开始安装 Nomic-embed-text:lates文本向量化大模型(安装时间较长请烦心等待)。

图 2.2‑7 windows运行窗口

图 2.2‑8 windows运行窗口

第5)步安装好后即可在运行窗口提示符下输入问题,大模型启动思考,本地机安装布署完成。

AnythingLLM软件

简介

AnythingLLM软件是一款支持多模型服务的客户端管理软件,并支持创建个人本地知识库,并对知识库进行管理。开发者为Mintplex Labs Inc.性质为开源软件,适用于 MacOS、Linux 和 Windows 操作系统。主要功能可创建本地知识库,文档支持 PDF、TXT、DOCX 等多种文档格式。

安装

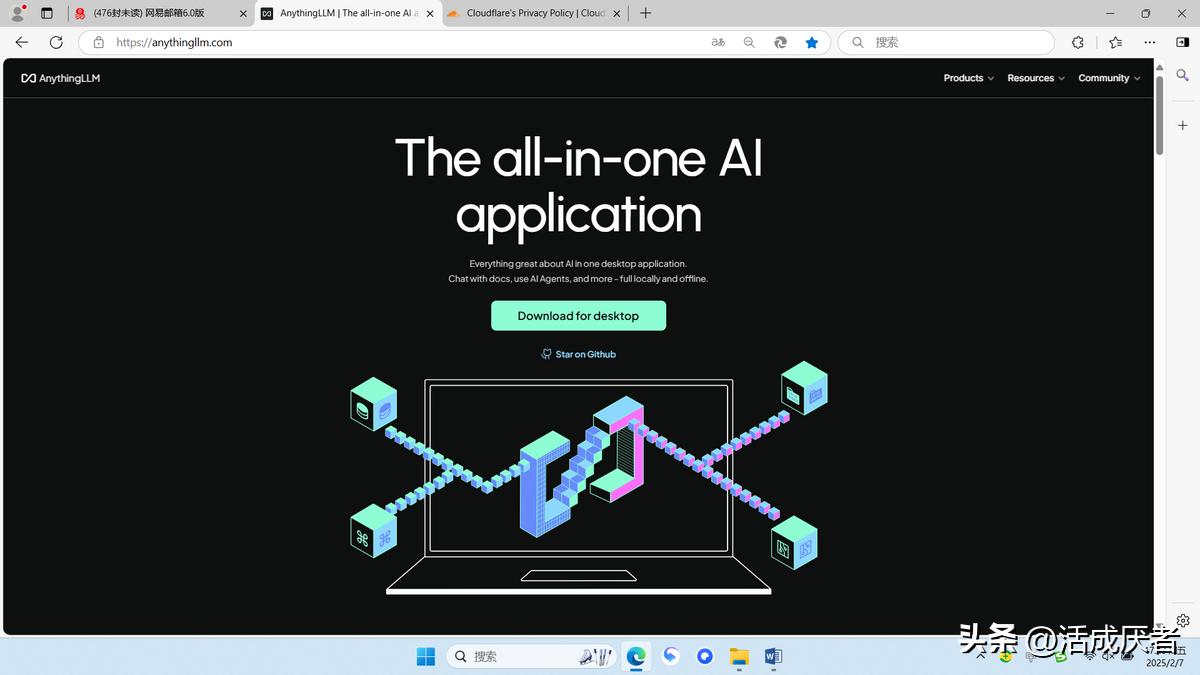

首先进入AngthingLLM软件网站:https://anythingllm.com/,如图 3.2‑1,选取对应选项→点击“Download for desktop” →文件进行下载模式→下载AngthingLLMDesktop.exe可执行文件→下载完成后双击安装。

图 3.2‑1 AnythingLLM网站

设置

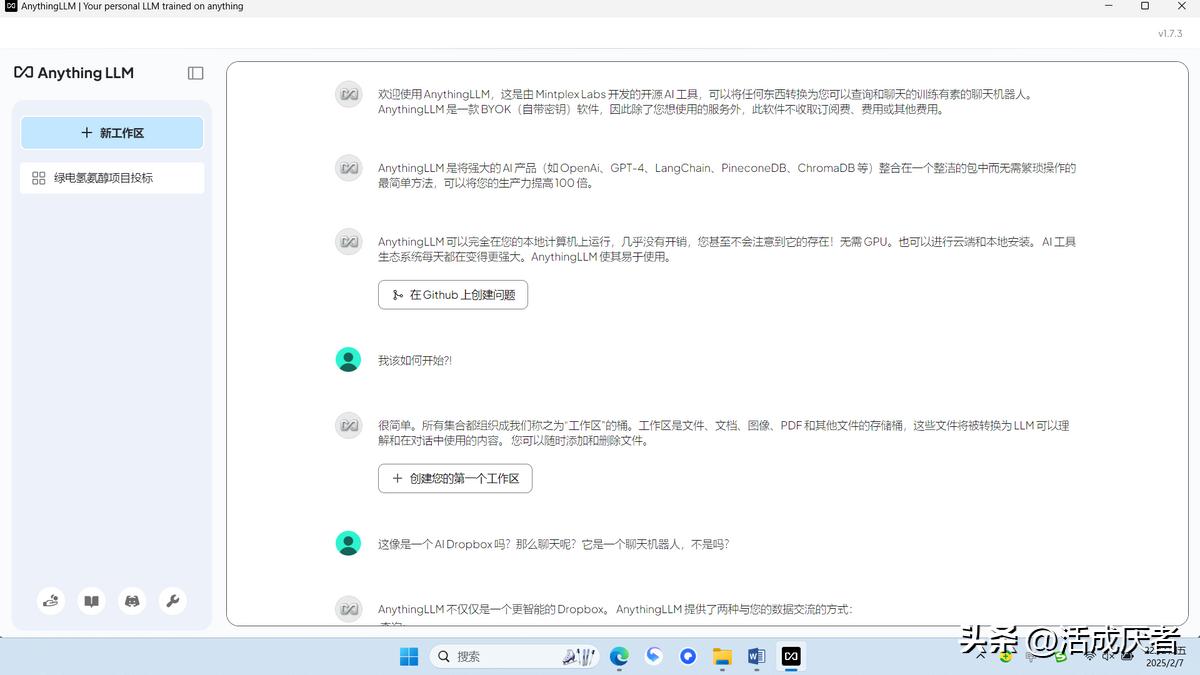

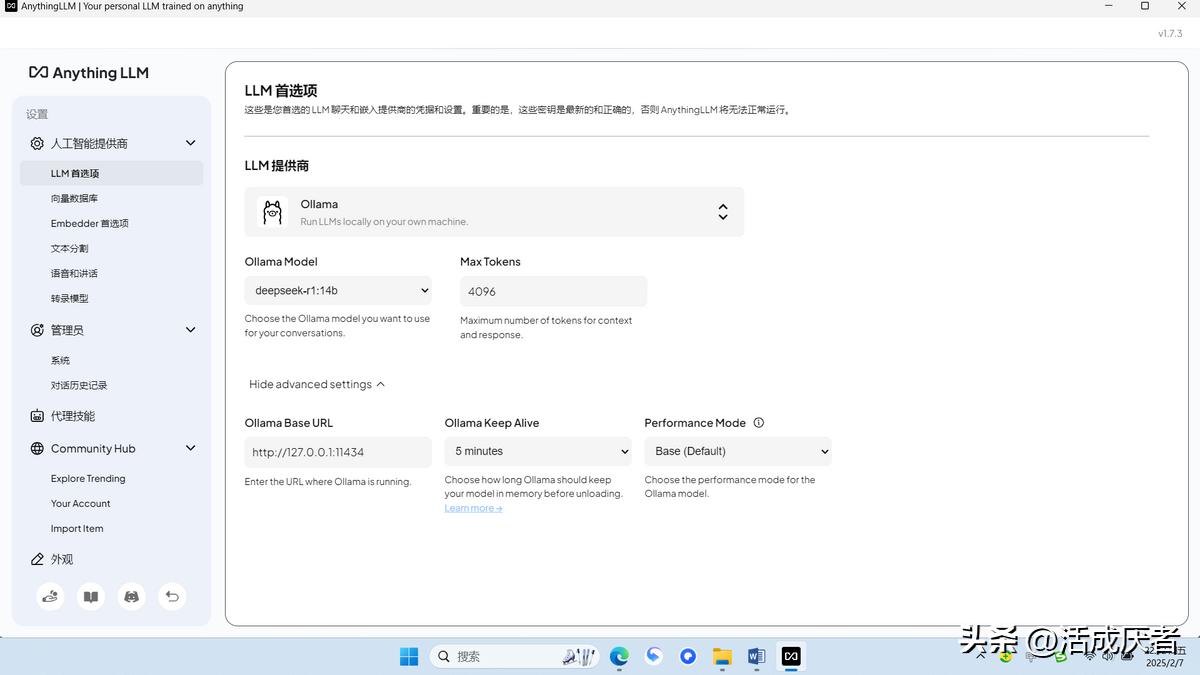

选取右下方红框中“设置“选项(图 3.3‑1)→弹出窗口(图 3.3‑2)中选“LLM首选项”→在图 3.3‑2右侧红框中选“ollama”→在下面框“ollama model”选“deepseek-r1”

图 3.3‑1 AnythingLLM程序页面

图 3.3‑2 AnythingLLM提供商页面

在图 3.3‑3中选“向量数据库”→弹出窗口中选LLM默认选项“LanceDB”

图 3.3‑3 AnythingLLM提供商页面

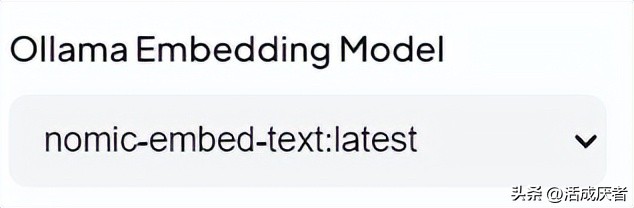

在图 3.3‑4中选“Embedder首选项”→弹出窗口“嵌入引擎供应商“中选ollama→”Ollama Embedding Model”选“nomic-embed-text:lates文本向量化模型。

图 3.3‑4 AnythingLLM提供商页面

在图 3.3‑5中创建新工作区→点左侧红框工作区设置→弹出窗口点“聊天设置“工作区LLM提供者选ollama→工作区聊天模型选deepseek-r1模型。

图 3.3‑5 AnythingLLM提供商页面

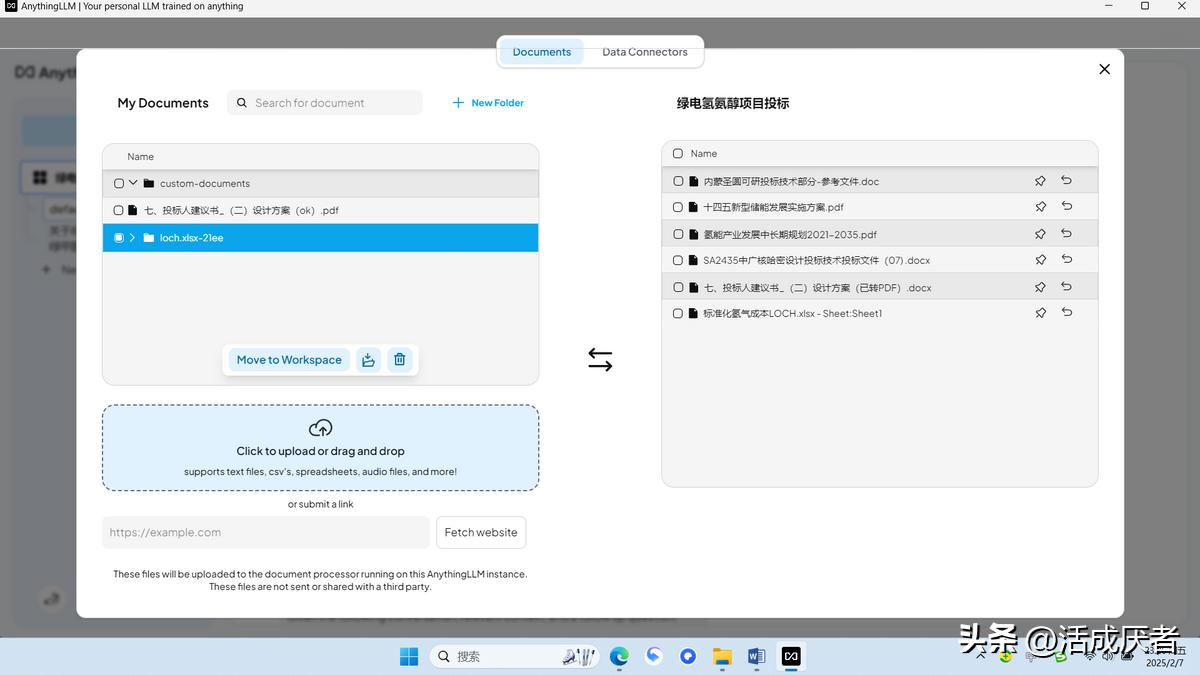

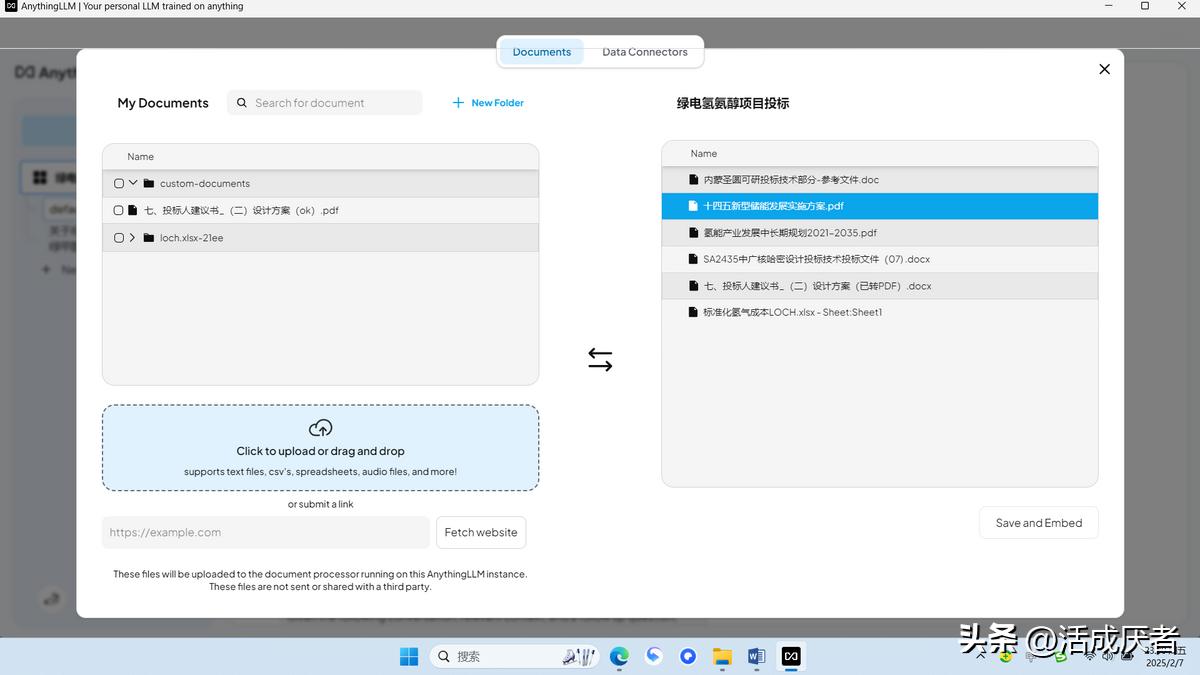

在图 3.3‑5中点”创建新工作区“右侧上传按钮→在图 3.3‑6点左下红框查找本地需上传文本文件→上传后在图图 3.3‑7中点”Move to workshop“→在图 3.3‑8点”Save and Embed“,对上传文件进行向量化。

图 3.3‑6 AnythingLLM提供商页面

图 3.3‑7 AnythingLLM提供商页面

图 3.3‑8 AnythingLLM提供商页面

Cheery studio软件

简介

CherryStudio是一个支持多平台的AI客户端,支持Win、macOS、Linux平台,未来也会支持移动端。项目自2024年7月至今已迭代数百个版本,我们致力于打造一个更加高效、安全、易用的客户端,让更多人能够享受到AI带来的便利。

安装

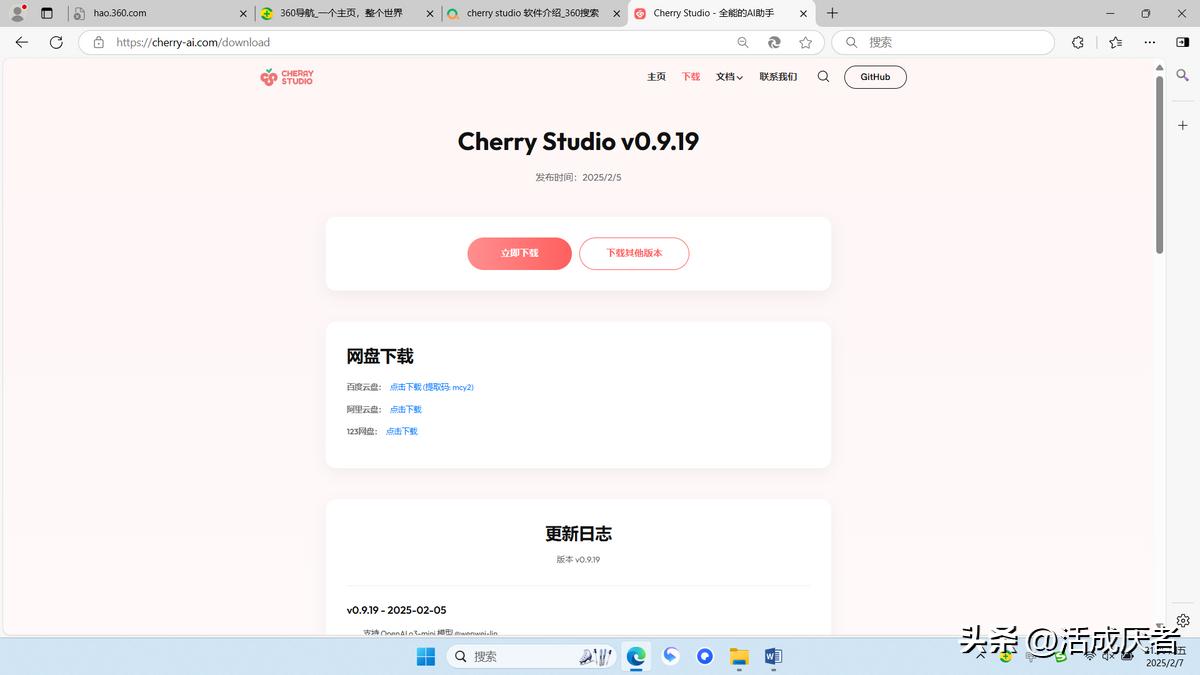

首先进入Cheery studio软件网站:https://cherry-ai.com/,如图 4.2‑1,选取对应选项→点击“立即下载”(图 4.2‑2) →文件进入下载模式→下载Cheery studio-0.9.19-setup.exe可执行文件→下载完成后双击安装。

图 4.2‑1 Cheery studio网站

图 4.2‑2 Cheery studio网站下载页面

设置

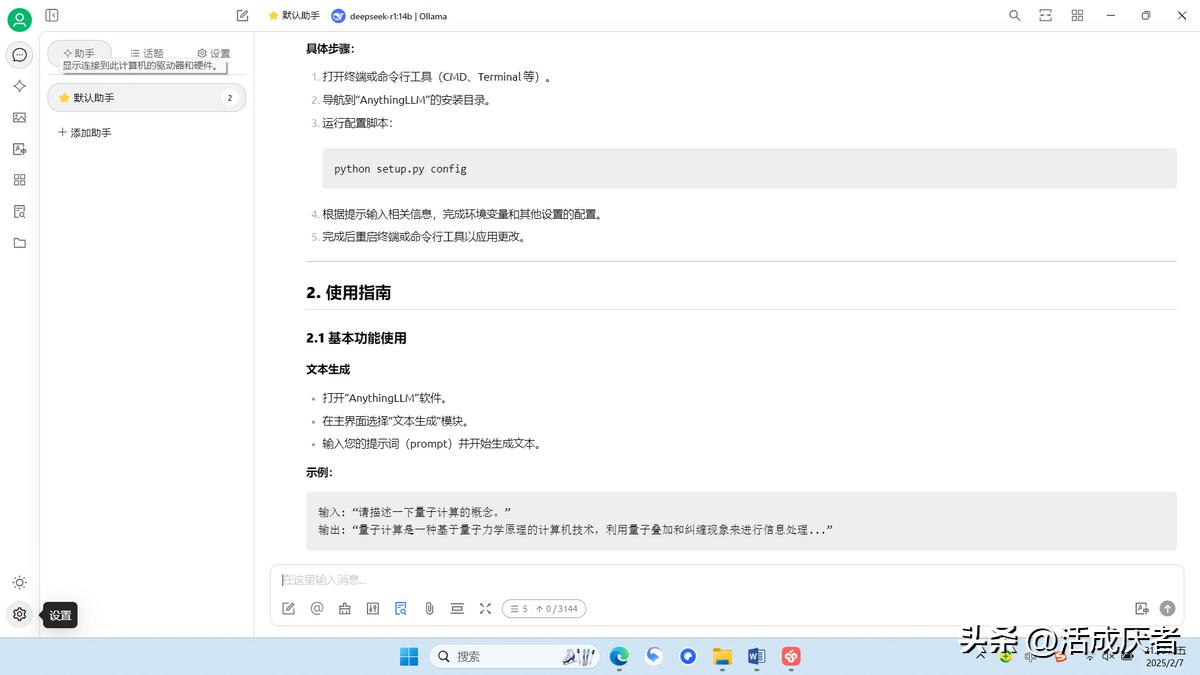

双击运行Cheery studio软件(如图 4.3‑1)→选取右下角“设置”。

图 4.3‑1 Cheery studio网站下载页面

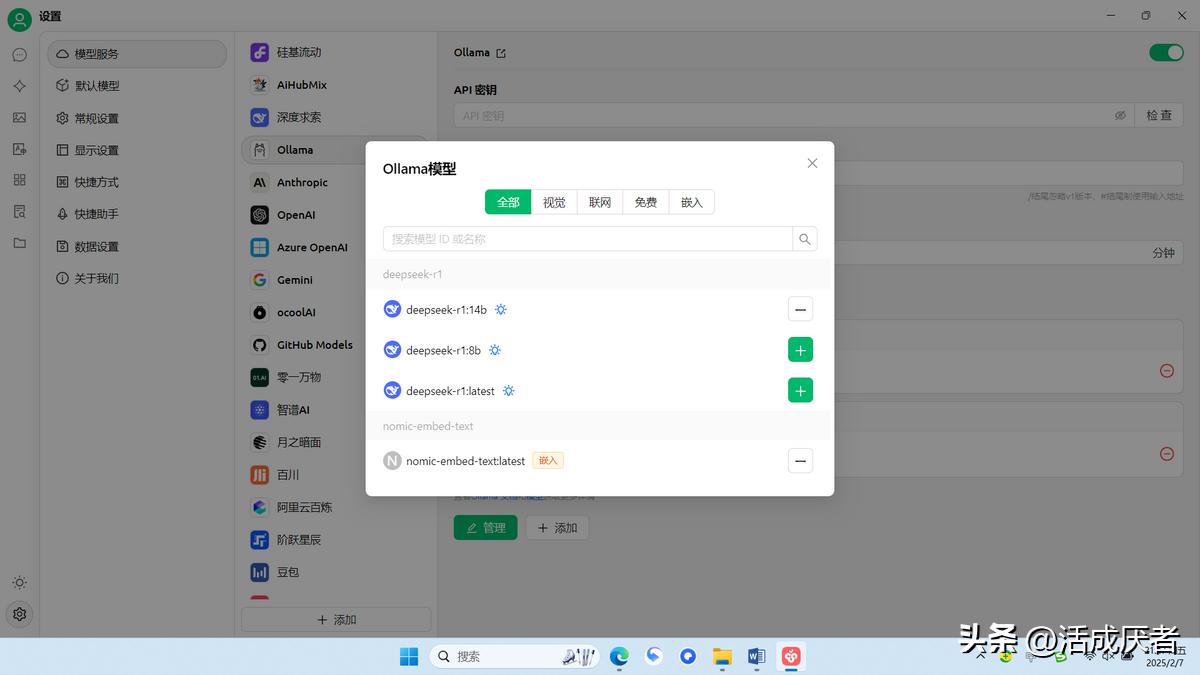

选取右侧“模型服务”(图 4.3‑2)→选取“ollama”(引用本地大模型) →选取右上角红框内“on”按钮(采用本地大模型不需要API key密钥)→选取下方“管理”→弹出模型设置窗口→点击“绿色+号”选取本地大模型。

图 4.3‑2 Cheery studio网站设置页

图 4.3‑3 Ollama模型设置页

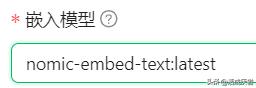

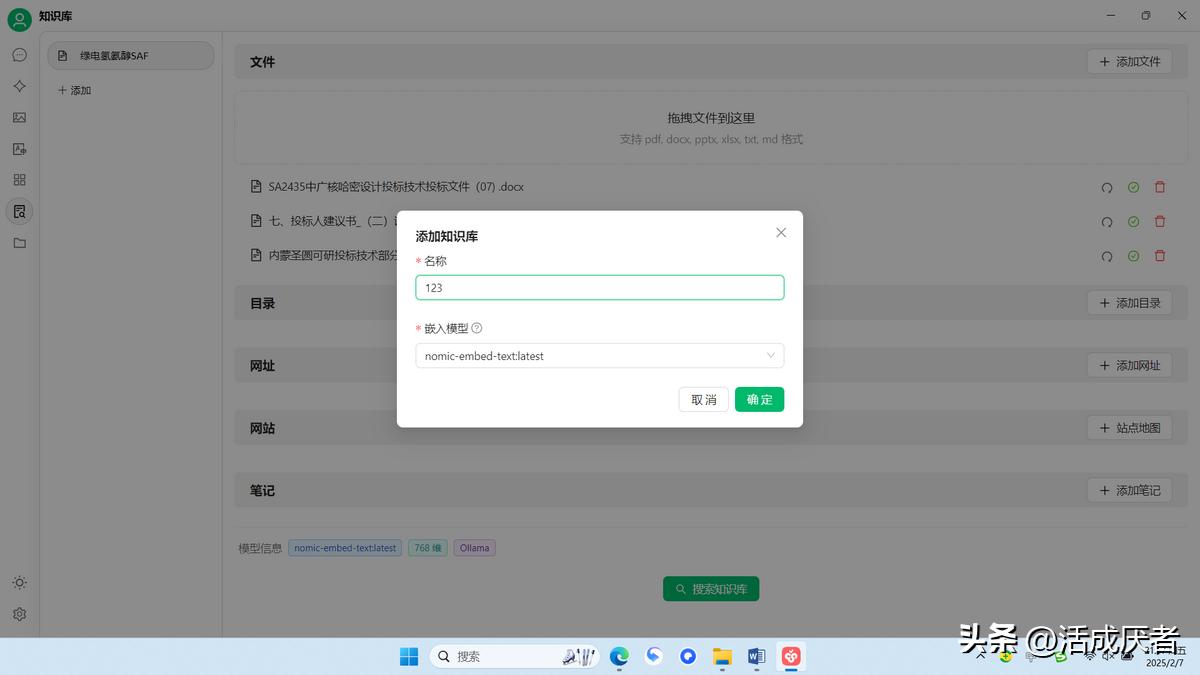

点右侧“知识库”(图 4.3‑4)→选取右上侧“添加”→弹出窗口(图 4.3‑4)→给知识库命名→选取本地向量化模型(用ollamag下载“nomic-embed-text:latest模型)

图 4.3‑4 知识库设置页

图 4.3‑5 知识库设置页